Ең аз квадраттар - Least squares

| Серияның бір бөлігі |

| Регрессиялық талдау |

|---|

|

| Модельдер |

| Бағалау |

| Фон |

|

Әдісі ең кіші квадраттар стандартты тәсіл регрессиялық талдау шешімін жуықтау анықталған жүйелер (белгісіздерге қарағанда теңдеулер көп болатын теңдеулер жиынтығы) әрбір жеке теңдеудің нәтижелерінде жасалған қалдықтардың квадраттарының қосындысын азайту арқылы.

Ең маңызды бағдарлама деректерді орналастыру. Ең кіші квадраттарға сәйкес келу мүмкіндігін азайтады квадраттың қосындысы қалдықтар (қалдық болмыс: бақыланатын мән мен модель ұсынған мән арасындағы айырмашылық). Мәселеде айтарлықтай белгісіздіктер болған кезде тәуелсіз айнымалы ( х айнымалы), содан кейін қарапайым регрессия және кіші квадраттар әдістері қиындықтар туғызады; мұндай жағдайларда фитингке қажетті әдістеме айнымалылардағы қателіктер модельдері оның орнына ең кіші квадраттар үшін қарастырылуы мүмкін.

Ең кіші квадраттар есептері екі санатқа бөлінеді: сызықтық немесе қарапайым ең кіші квадраттар және сызықты емес квадраттар, қалдықтардың барлық белгісіздерде сызықтық болуына немесе болмауына байланысты. Сызықтық ең кіші квадраттар есебі статистикалық жағдайда кездеседі регрессиялық талдау; ол бар жабық түрдегі шешім. Сызықты емес мәселе әдетте қайталанатын нақтылау арқылы шешіледі; әр қайталану кезінде жүйе сызықтық бойынша жақындатылады, осылайша екі жағдайда да ядроны есептеу ұқсас болады.

Ең көп квадраттар тәуелді айнымалының функциясы ретінде тәуелді айнымалыны болжаудағы дисперсияны және орнатылған қисықтан ауытқуды сипаттайды.

Бақылаулар ан экспоненциалды отбасы және жұмсақ шарттар қанағаттандырылады, ең кіші квадраттық бағалау және максималды ықтималдығы бағалау бірдей.[1] Ең кіші квадраттар әдісін а түрінде де алуға болады сәттер әдісі бағалаушы.

Келесі талқылау негізінен ұсынылады сызықтық функциялар, бірақ ең кіші квадраттарды қолдану функциялардың жалпы отбасыларына жарамды және практикалық. Сондай-ақ, жергілікті квадраттық жуықтауды ықтималдылыққа итеративті қолдану арқылы (арқылы Фишер туралы ақпарат ), а-ны сәйкестендіру үшін ең кіші квадраттар әдісі қолданылуы мүмкін жалпыланған сызықтық модель.

Ең кіші квадраттар әдісі ресми түрде ашылды және жарияланды Адриен-Мари Легендр (1805),[2] дегенмен, ол әдетте бірге есептеледі Карл Фридрих Гаусс (1795)[3][4] әдістемеге айтарлықтай теориялық жетістіктер енгізген және оны бұрын өз жұмысында қолданған болуы мүмкін.[5][6]

Тарих

Құру

Өрістерден кіші квадраттар әдісі өсіп шықты астрономия және геодезия, өйткені ғалымдар мен математиктер Жер мұхитында жылжу кезіндегі қиындықтарды шешуді қамтамасыз етуге ұмтылды Барлау жасы. Аспан денелерінің мінез-құлқының нақты сипаттамасы кемелерге ашық теңізде жүзуге мүмкіндік беретін кілт болды, мұнда теңізшілер енді навигация кезінде құрлықтағы көріністерге сене алмайтын болды.

Бұл әдіс ХVІІІ ғасырда болған бірнеше жетістіктердің шарықтау шегі болды:[7]

- Шынайы құнды ең жақсы бағалау ретінде әр түрлі бақылаулар үйлесімі; қателіктер көбейгеннен гөрі біріктіріле отырып азаяды, мүмкін алдымен олар арқылы көрінеді Роджер Котес 1722 жылы.

- Аясында алынған әр түрлі бақылаулардың тіркесімі бірдей жай ғана бір бақылауды дәл бақылауға және жазуға бар күшін салуға қайшы жағдайлар. Бұл тәсіл орташа мәндер әдісі ретінде белгілі болды. Бұл тәсілді әсіресе қолданған Тобиас Майер оқу кезінде кітапханалар 1750 ж. және одан кейін Пьер-Симон Лаплас қозғалысындағы айырмашылықтарды түсіндірудегі өз жұмысында Юпитер және Сатурн 1788 жылы.

- Әр түрлі бақылаулардың тіркесімі әр түрлі шарттар. Әдіс ең аз абсолютті ауытқу әдісі ретінде белгілі болды. Мұны ерекше орындады Роджер Джозеф Боскович оның жердің пішіні туралы жұмысында 1757 ж Пьер-Симон Лаплас сол проблема үшін 1799 ж.

- Минималды қателікпен шешімге қашан қол жеткізілгенін анықтауға болатын критерийді әзірлеу. Лаплас.-Тің математикалық түрін көрсетуге тырысты ықтималдық қателіктер үшін тығыздық және бағалау қателігін минимизациялайтын бағалау әдісін анықтаңыз. Осы мақсатта Лаплас біз қазір атайтын симметриялы екі жақты экспоненциалды үлестіруді қолданды Лапластың таралуы қателіктердің үлестірілуін модельдеу үшін және абсолютті ауытқудың қосындысын бағалау қателігі ретінде қолданды. Ол мұны өзі жасай алатын қарапайым болжамдар деп санады және ең жақсы баға ретінде арифметикалық ортаны аламын деп үміттенді. Оның орнына оның бағалаушысы артқы медиана болды.

Әдіс

Ең кіші квадраттар әдісінің алғашқы анық және нақты экспозициясы жарияланды Легенда 1805 жылы.[8] Техника сызықтық теңдеулерді деректерге сәйкестендірудің алгебралық процедурасы ретінде сипатталған және Легендр жердің пішіні үшін Лаплас сияқты деректерді талдай отырып, жаңа әдісті көрсетеді. Легендрдің ең кіші квадраттар әдісінің құндылығын сол кездегі жетекші астрономдар мен геодезистер бірден мойындады.[дәйексөз қажет ]

1809 жылы Карл Фридрих Гаусс өзінің аспан денелерінің орбиталарын есептеу әдісін жариялады. Бұл жұмыста ол 1795 жылдан бастап ең кіші квадраттар әдісін қолданады деп мәлімдеді. Бұл, әрине, Легандрмен бірінші кезектегі дау тудырды. Алайда, Гаусстың еңбегі үшін ол Легендра шеңберінен шығып, ең кіші квадраттар әдісін ықтималдылық принциптерімен байланыстыра алды қалыпты таралу. Ол Лапластың бақылаулар үшін ықтималдық тығыздығының математикалық түрін, белгісіз параметрлердің ақырлы санына байланысты анықтау бағдарламасын аяқтап, бағалау қателігін минимизациялайтын бағалау әдісін анықтай алды. Гаусс көрсеткендей орташа арифметикалық екеуін де өзгерту арқылы орналасу параметрінің ең жақсы бағасы болып табылады ықтималдық тығыздығы және бағалау әдісі. Содан кейін ол тығыздықтың қандай формасы болу керектігін және орналасу параметрін бағалау кезінде орташа арифметикалық мәнді алу үшін қандай бағалау әдісін қолдану керектігін сұрай отырып, мәселені шешті. Бұл әрекетте ол қалыпты үлестіруді ойлап тапты.

-Ның күшін ерте көрсету Гаусс әдісі ол жаңа ашылған астероидтың болашақ орнын болжау үшін қолданылған кезде келді Сериялар. 1801 жылы 1 қаңтарда итальян астрономы Джузеппе Пяцци Ceres ашты және күн сәулесінде жоғалғанға дейін оның жолын 40 күн бойы бақылай алды. Осы мәліметтерге сүйене отырып, астрономдар Ceres-тің күннің артынан шыққаннан кейін оның орналасуын анықтағысы келді Кеплердің күрделі бейсызық теңдеулері планеталық қозғалыс. Венгриялық астрономға сәтті мүмкіндік берген жалғыз болжам Франц Ксавер фон Зак 24 жастағы Гаусс ең кіші квадраттар анализін қолданып өткізген.

1810 жылы Гаусстың Лаплас шығармасын оқығаннан кейін, дәлелдегеннен кейін орталық шек теоремасы, оны ең кіші квадраттар әдісі және қалыпты үлестіру үшін үлкен үлгі негіздеу үшін қолданды. 1822 жылы Гаусс регрессиялық талдауға ең кіші квадраттар тәсілінің қателіктері орташа мәні нөлге, өзара байланыссыз және бірдей дисперсияларға ие болатын сызықтық модельде оңтайлы болатындығын айта алды, бұл ең жақсы сызықтық объективті бағалаушы коэффициенттер ең кіші квадраттарды бағалайды. Бұл нәтиже ретінде белгілі Гаусс-Марков теоремасы.

Кіші квадраттарды талдау идеясын да американдық өздігінен тұжырымдады Роберт Адрейн Келесі екі ғасырда жұмысшылар қателер теориясында және статистикада ең кіші квадраттарды жүзеге асырудың әр түрлі тәсілдерін тапты.[9]

Проблеманы шешу

Мақсат модель функцияларының параметрлерін мәліметтер жиынтығына ең жақсы сәйкестендіруден тұрады. Қарапайым мәліметтер жиынтығы мыналардан тұрады n нүктелер (деректер жұптары) , мен = 1, ..., n, қайда болып табылады тәуелсіз айнымалы және Бұл тәуелді айнымалы оның мәні бақылау арқылы табылған. Модель функциясының формасы болады , қайда м реттелетін параметрлер векторда ұсталады . Мақсат - деректерге сәйкес келетін «ең жақсы» модель үшін параметр мәндерін табу. Модельдің деректер нүктесіне сәйкестігі онымен өлшенеді қалдық, тәуелді айнымалының нақты мәні мен модель болжаған шаманың айырмасы ретінде анықталады:

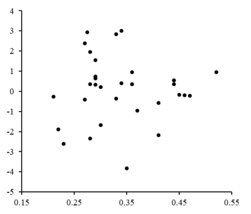

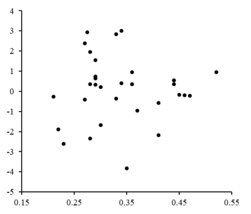

Қалдықтар сәйкес келеді құндылықтар. Туралы кездейсоқ ауытқулар сызықтық модельдің орынды екендігін көрсетіңіз.

Қалдықтар сәйкес келеді құндылықтар. Туралы кездейсоқ ауытқулар сызықтық модельдің орынды екендігін көрсетіңіз.

Ең кіші квадраттар әдісі қосындысын азайту арқылы параметрдің оңтайлы мәндерін табады, , квадрат қалдықтары:

Екі өлшемдегі модельдің мысалы - түзу сызық. Y-кесіндісін ретінде белгілейді және көлбеу , модель функциясы арқылы беріледі . Қараңыз сызықтық ең кіші квадраттар осы модельдің толық өңделген мысалы үшін.

Мәліметтер нүктесі бірнеше тәуелсіз айнымалылардан тұруы мүмкін. Мысалы, жазықтықты биіктік өлшемдерінің жиынтығына сәйкестендіру кезінде жазықтық екі тәуелсіз айнымалының функциясы болып табылады, х және з, айт. Ең жалпы жағдайда әрбір деректер нүктесінде бір немесе бірнеше тәуелсіз айнымалылар және бір немесе бірнеше тәуелді айнымалылар болуы мүмкін.

Оң жағында кездейсоқ ауытқуларды бейнелейтін қалдық сюжет орналасқан , бұл сызықтық модель екенін көрсетеді сәйкес келеді. тәуелсіз, кездейсоқ шама.[10]

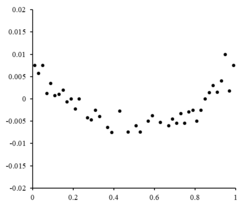

Егер қалдық нүктелердің қандай-да бір формасы болса және кездейсоқ өзгермесе, сызықтық модель орынды болмас еді. Мысалы, егер қалдық сюжет оң жақта көрсетілгендей параболалық пішінге ие болса, параболалық модель деректер үшін орынды болар еді. Параболалық модель үшін қалдықтарды есептеуге болады .[10]

Шектеулер

Бұл регрессия тұжырымдамасы тек тәуелді айнымалыдағы байқау қателіктерін қарастырады (бірақ балама) ең кіші квадраттар регрессия екі айнымалының қателіктерін ескере алады). Әр түрлі салдары бар екі түрлі контекст бар:

- Болжау үшін регрессия. Мұнда модельге сәйкес келтіру үшін пайдаланылатын деректер қолданылатын ұқсас жағдайда қолдану ережесін ұсынуға болады. Мұнда болашақтағы осындай қолдануға сәйкес келетін тәуелді айнымалылар монтаждау үшін пайдаланылған мәліметтердегідей қателіктер байқалуы мүмкін. Сондықтан мұндай мәліметтер үшін ең кіші квадраттарды болжау ережесін қолдану қисынды.

- «Нағыз қатынасты» орнатуға арналған регрессия. Стандарт бойынша регрессиялық талдау квадраттардың қиыстырылуына әкелетін қателіктер туралы жасырын болжам бар тәуелсіз айнымалы нөлге тең немесе қатаң бақыланады, сондықтан олар елеусіз болады. Қателер болған кезде тәуелсіз айнымалы ескерілмейді, өлшеу қателігінің модельдері пайдалануға болады; мұндай әдістер әкелуі мүмкін параметрлік бағалау, гипотезаны тексеру және сенімділік аралықтары тәуелсіз айнымалыларда байқау қателіктерінің болуын ескеретін.[11] Баламалы тәсіл - модельді сәйкестендіру ең кіші квадраттар; Мұны модельде қолдану үшін объективті функцияны құруда қателіктердің әр түрлі көздерінің әсерін теңдестіруге прагматикалық тәсілдеме ретінде қарастыруға болады.

Ең кіші квадраттарға есептер шығару

The минимум квадраттардың қосындысын орнату арқылы табады градиент нөлге дейін. Модельде болғандықтан м параметрлер бар, бар м градиенттік теңдеулер:

және содан бері , градиенттік теңдеулер болады

Градиенттік теңдеулер барлық кіші квадраттарға арналған есептерге қолданылады. Әрбір нақты мәселе модель үшін және оның ішінара туындылары үшін белгілі бір өрнектерді қажет етеді.[12]

Сызықтық ең кіші квадраттар

Регрессия моделі - бұл моделдің құрамында a болатын сызықтық модель сызықтық комбинация параметрлердің, яғни,

функция қайда функциясы болып табылады .[12]

Рұқсат ету және тәуелсіз және тәуелді айнымалыларды матрицаларға енгізу және біз ең кіші квадраттарды келесі түрде есептей аламыз, ескеріңіз - бұл барлық мәліметтер жиынтығы. [12][13]

Минималды табуға шығынның градиентін нөлге қойып, үшін шешу арқылы қол жеткізуге болады

Соңында шығынның градиентін нөлге теңестіріп, оны шешіңіз Біз алып жатырмыз: [13][12]

Сызықтық емес ең кіші квадраттар

Кейбір жағдайларда а жабық түрдегі шешім сызықтық емес ең кіші квадраттар есебіне - бірақ жалпы алғанда ондай емес. Жабық түрдегі шешім болмаған жағдайда, параметрлердің мәнін табу үшін сандық алгоритмдер қолданылады бұл мақсатты азайтады. Көптеген алгоритмдер параметрлер үшін бастапқы мәндерді таңдауды қамтиды. Содан кейін параметрлер қайталанатын түрде нақтыланады, яғни мәндер бір-біріне жақындау арқылы алынады:

қайда жоғарғы әріп к бұл қайталану саны және өсу векторы ауысым векторы деп аталады. Кейбір жиі қолданылатын алгоритмдерде әр қайталану кезінде модель бірінші ретті жақындату арқылы сызықтық сипатта болуы мүмкін Тейлор сериясы туралы кеңейту :

The Якобиан Дж тұрақты функциясы, тәуелсіз айнымалы және параметрлер, сондықтан ол бір итерациядан келесі итерацияға ауысады. Қалдықтар берілген

Квадраттарының қосындысын азайту үшін , градиент теңдеуі нөлге теңестіріліп, шешіледі :

қайта құру кезінде айналады м бір уақытта сызықтық теңдеулер, қалыпты теңдеулер:

Қалыпты теңдеулер матрицалық жазба түрінде жазылады

Бұл анықтайтын теңдеулер Гаусс-Ньютон алгоритмі.

Сызықтық және сызықтық емес ең кіші квадраттардың айырмашылықтары

- Модель функциясы, f, LLSQ-де (сызықтық ең кіші квадраттар) форма параметрлерінің сызықтық комбинациясы болып табылады Модель функциялардың түзу сызығын, параболасын немесе кез-келген басқа сызықтық тіркесімін көрсете алады. NLLSQ-де (сызықтық емес кіші квадраттар) параметрлер функциялар ретінде пайда болады, мысалы және т.б. Егер туынды не тұрақты, не тәуелсіз айнымалының мәндеріне ғана тәуелді, модель параметрлері бойынша сызықтық болып табылады. Әйтпесе модель сызықты емес.

- NLLSQ есебінің шешімін табу үшін параметрлер үшін бастапқы мәндер қажет; LLSQ оларды қажет етпейді.

- NLLSQ шешімінің алгоритмдері көбінесе якобияндықты LLSQ сияқты есептеуге болатындығын талап етеді. Жартылай туындыларға арналған аналитикалық өрнектер күрделі болуы мүмкін. Егер аналитикалық өрнектерді алу мүмкін болмаса, ішінара туындыларды сандық жуықтау арқылы есептеу керек немесе якобиялықтың бағасын көбінесе арқылы жасау керек ақырғы айырмашылықтар.

- Конвергенция болмауы (алгоритмнің минимумды таба алмауы) NLLSQ-де кең таралған құбылыс.

- LLSQ жаһандық вогнуты болып табылады, сондықтан конвергенция жоқ.

- NLLSQ шешімі - бұл конвергенция критерийі орындалған кезде тоқтатылатын қайталанатын процесс. LLSQ шешімдерін тікелей әдістерді қолдана отырып есептеуге болады, дегенмен көптеген параметрлерге қатысты мәселелер көбінесе қайталанатын әдістермен шешіледі, мысалы Гаусс-Зайдель әдіс.

- LLSQ-де шешім ерекше, бірақ NLLSQ-де квадраттардың қосындысында бірнеше минимумдар болуы мүмкін.

- Қателер болжамды айнымалылармен байланыссыз болған жағдайда, LLSQ объективті емес баға береді, бірақ тіпті сол жағдайда NLLSQ бағалары негізінен біржақты болады.

Бұл айырмашылықтар сызықтық емес ең кіші квадраттар есебінің шешімі ізделінген кезде ескерілуі керек.[12]

Регрессиялық талдау және статистика

Ең кіші квадраттар әдісі көбінесе регрессиялық талдауда бағалаушыларды және басқа статистикаларды құру үшін қолданылады.

Физикадан алынған қарапайым мысалды қарастырайық. Бұлақ мойынсұнуы керек Гук заңы бұл серіппенің созылуы деп көрсетілген ж күшке пропорционалды, F, оған қолданылады.

моделін құрайды, мұндағы F тәуелсіз айнымалы болып табылады. Бағалау үшін күш тұрақтысы, к, біз бірқатар өткіземіз n мәліметтер жиынтығын алу үшін әртүрлі күштермен өлшеу, , қайда жмен бұл өлшенген серіппенің созылуы.[14] Әрбір эксперименттік бақылауда кейбір қателіктер болады, , сондықтан біз өз бақылауларымыздың эмпирикалық моделін көрсете аламыз,

Белгісіз параметрді бағалау үшін көптеген әдістерді қолдануға болады к. Бастап n теңдеулер м біздің деректеріміздегі айнымалылар ан анықталған жүйе бір белгісіз және n теңдеулер, біз бағалаймыз к ең кіші квадраттарды қолдану. Минималдауға болатын квадраттардың қосындысы

Күш тұрақтысының ең кіші квадраттары, к, арқылы беріледі

Біз күш қолдану деп болжаймыз себептері кеңейту үшін көктем. Күштің тұрақтылығын ең кіші квадраттарға келтіргеннен кейін, біз Гук заңынан кеңейтуді болжаймыз.

Зерттеуші регрессиялық талдау кезінде эмпирикалық модельді көрсетеді. Өте кең таралған модель - бұл тәуелсіз және тәуелді айнымалылар арасында сызықтық байланыс бар-жоғын тексеру үшін қолданылатын түзу сызық моделі. Айнымалылар деп аталады өзара байланысты егер сызықтық қатынас болса. Алайда, корреляция себептілікті дәлелдемейді, екі айнымалы басқа, жасырын, айнымалылармен байланысты болуы мүмкін немесе тәуелді айнымалылар «кері» тәуелді айнымалыларға себеп болуы мүмкін немесе айнымалылар басқаша жалған өзара байланысты болуы мүмкін. Мысалы, суға батып өлу мен белгілі бір жағажайда балмұздақ сату көлемі арасында өзара байланыс бар делік. Суға шомылуға бара жатқан адамдардың саны да, балмұздақ сатылымы да ауа-райы жылынған сайын ұлғаюда, суға батып қаза болғандардың саны суға түсетіндердің санымен байланысты. Жүзушілердің көбеюі басқа айнымалылардың да көбеюіне себеп болуы мүмкін.

Нәтижелерді статистикалық тексеру үшін эксперименттік қателіктердің сипаты туралы болжамдар жасау қажет. Жалпы болжам - қателер қалыпты үлестірілімге жатады. The орталық шек теоремасы бұл көптеген жағдайларда жақсы жуықтау деген идеяны қолдайды.

- The Гаусс-Марков теоремасы. Қателері бар сызықтық модельде күту нөлдік тәуелсіз айнымалыларға шартты, болып табылады байланысты емес және тең дисперсиялар, ең жақсы сызықтық объективті емес бақылаулардың кез-келген сызықтық комбинациясының бағалаушысы, бұл ең кіші квадраттардың бағалаушысы. «Үздік» дегеніміз - параметрлердің ең кіші квадраттар бағалаушылары минималды дисперсияға ие. Қателіктердің барлығы бірдей үлестірімге жатқанда, бірдей дисперсия туралы болжам дұрыс болады.

- Сызықтық модельде, егер қателер қалыпты үлестірілімге жатса, ең кіші квадраттардың бағалаушылары да болады ықтималдықтың максималды бағалаушылары.

Алайда, егер қателер әдеттегідей таратылмаса, а орталық шек теоремасы көбінесе, егер параметр шамалы болған жағдайда, параметрлік бағалау шамамен қалыпты бөлінеді дегенді білдіреді. Осы себепті қатенің орташа мәні тәуелсіз айнымалылардан тәуелді болатын маңызды қасиетін ескере отырып, қателік терминінің таралуы регрессиялық талдауда маңызды мәселе емес. Дәлірек айтқанда, қате терминінің қалыпты үлестірімге сәйкес келуі маңызды емес.

Бірлік салмақтары бар ең аз квадраттар есебінде немесе сызықтық регрессияда бойынша дисперсия jth параметр, белгіленеді , әдетте сандармен бағаланады

мұндағы шынайы қателік дисперсиясы σ2 мақсат функциясының квадраттарының қосындысының минималды мәніне негізделген бағалауға ауыстырылады S. Бөлгіш, n − м, болып табылады статистикалық еркіндік дәрежелері; қараңыз тиімді бостандық дәрежелері жалпылау үшін.[12]

Егер ықтималдықтың таралуы параметрлері белгілі немесе асимптотикалық жуықтау жасалады, сенімділік шегі табуға болады. Дәл сол сияқты қалдықтар бойынша статистикалық сынақтарды, егер қалдықтардың ықтималдық үлестірімі белгілі болса немесе қабылданса, жүргізуге болады. Тәуелді айнымалылардың кез-келген сызықтық комбинациясының ықтималдық үлестірімін, егер эксперименттік қателіктердің ықтималдық үлестірімі белгілі болса немесе алса, аламыз. Қателер қалыпты үлестірімге сәйкес келеді деп тұжырымдау оңай, демек, параметрлердің бағалары мен қалдықтары тәуелсіз айнымалылардың мәндеріне байланысты қалыпты түрде бөлінетіндігін білдіреді.[12]

Салмағы аз квадраттар

Ерекше жағдай жалпыланған ең кіші квадраттар деп аталады ең кіші квадраттар барлық диагональды емес жазбалар кезінде пайда болады Ω (қалдықтардың корреляциялық матрицасы) нөл; The дисперсиялар бақылаулардың (ковариация матрицасының қиғаш бойымен) әлі тең болмауы мүмкін (гетероскедастикалық ). Қарапайым тілмен айтқанда гетероскедастикалық қашан болатындығы мәніне байланысты бұл қалдық сюжетті үлкенге қарай «желпу» әсерін тудырады қалдық учаскеден оңға қарай көрінетін мәндер. Басқа жақтан, гомоскедастикалық дисперсиясын болжайды және тең.[10]

Негізгі компоненттермен байланыс

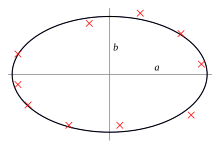

Бірінші негізгі компонент нүктелер жиынтығының орташа мәні туралы мәліметтер нүктелеріне ең жақын болатын сызықпен ұсынуға болады (ең жақын жақындаудың квадраттық қашықтығымен өлшенеді, яғни түзуге перпендикуляр). Керісінше, сызықтық ең кіші квадраттар арасындағы қашықтықты азайтуға тырысады тек бағыт. Осылайша, екеуі де ұқсас қателіктер көрсеткішін қолданғанымен, сызықтық ең кіші квадраттар - бұл мәліметтердің бір өлшеміне артықшылық беретін әдіс, ал PCA барлық өлшемдерге бірдей қарайды.

Регуляризация

Бұл бөлім оқырмандардың көпшілігінің түсінуіне тым техникалық болуы мүмкін. өтінемін оны жақсартуға көмектесу дейін оны мамандар емес адамдарға түсінікті етіңіз, техникалық мәліметтерді жоймай. (Ақпан 2016) (Бұл шаблон хабарламасын қалай және қашан жою керектігін біліп алыңыз) |

Тихоновты жүйелеу

Кейбір жағдайларда а реттелген ең кіші квадраттар шешімінің нұсқасы жақсырақ болуы мүмкін. Тихоновты жүйелеу (немесе жотаның регрессиясы ) деген шектеу қосады , L2-норм параметр векторының мәні берілген мәннен үлкен емес.[дәйексөз қажет ] Эквивалентті,[күмәнді ] бұл ең кіші квадрат айыппұлды шектеусіз азайтуды шешуі мүмкін қосылды, қайда тұрақты болып табылады (бұл Лагранж шектеулі есептің формасы). Ішінде Байес контекст, бұл қалыпты үлестірілген нөлдік мәнді орналастыруға тең дейін параметр векторында.

Лассо әдісі

Балама реттелген ең кіші квадраттардың нұсқасы Лассо (ең кіші абсолютті жиырылу және таңдау операторы), бұл шектеуді қолданады , L1-норм параметр векторының мәні берілген мәннен үлкен емес.[15][16][17] (Жоғарыда айтылғандай, бұл балама[күмәнді ] -мен ең кіші төртбұрышты айыппұлды шектеусіз азайтуға дейін қосылды.) а Байес контекст, бұл нөлдік мәнді орналастыруға тең Лаплас алдын-ала тарату параметр векторында.[18] Оңтайландыру мәселесін қолдану арқылы шешілуі мүмкін квадраттық бағдарламалау немесе жалпы дөңес оңтайландыру әдістері, сондай-ақ. сияқты арнайы алгоритмдер бойынша ең кіші бұрыштық регрессия алгоритм.

Лассо мен жотаның регрессиясының негізгі айырмашылықтарының бірі - жотаның регрессиясында айыппұлдың ұлғаюына байланысты барлық параметрлер нөлге тең емес күйде азаяды, ал Лассода айыппұлды көбейту параметрлердің көбірек болуына әкеледі нөлге жетеді. Бұл Lasso-дің жоталардың регрессиясынан артықшылығы, өйткені параметрлерді нөлге ауыстыру регрессияның ерекшеліктерін алып тастайды. Осылайша, Лассо автоматты түрде неғұрлым маңызды сипаттамаларды таңдап, басқаларын алып тастайды, ал Ридж регрессиясы ешқашан ешқандай ерекшеліктерді толығымен жоймайды. Кейбіреулер функцияны таңдау LASSO, соның ішінде Bolasso үлгілері жүктелетін әдістемелер,[19] және әр түрлі мәндерге сәйкес келетін регрессия коэффициенттерін талдайтын FeaLect барлық мүмкіндіктерді жинау үшін.[20]

L1-реттелген тұжырымдама кейбір мәндерге пайдалы, себебі көп параметрлер нөлге тең болатын шешімдерге артықшылық береді, бұл аз айнымалыларға тәуелді шешімдер береді.[15] Осы себепті Лассо және оның нұсқалары өріс үшін негіз болып табылады қысылған зондтау. Бұл тәсілді кеңейту желінің серпімді регуляризациясы.

Сондай-ақ қараңыз

- Бақылауларды түзету

- Bayesian MMSE бағалаушысы

- Үздік сызықтық бағалаушы (КӨК)

- Үздік сызықтық болжам (BLUP)

- Гаусс-Марков теоремасы

- L2 норма

- Ең аз абсолюттік ауытқу

- Өлшеу белгісіздігі

- Ортогональ проекция

- Оқытуға арналған градиенттің проксимальды әдістері

- Квадраттық шығын функциясы

- Орташа квадрат

- Квадраттық ауытқулар

Әдебиеттер тізімі

- ^ Чарнес, А .; Фром, Э.Л .; Yu, P. L. (1976). «Экспоненциалды отбасындағы жалпыланған ең кіші квадраттардың баламасы және максималды ықтималдылық бағалары». Американдық статистикалық қауымдастық журналы. 71 (353): 169–171. дои:10.1080/01621459.1976.10481508.

- ^ Мэнсфилд Мерриман, «Ең кіші квадраттар әдісіне қатысты жазбалар тізімі»

- ^ Бретчер, Отто (1995). Қолданбалы сызықтық алгебра (3-ші басылым). Жоғарғы седла өзені, NJ: Prentice Hall.

- ^ Стиглер, Стивен М. (1981). «Гаусс және ең аз квадраттардың өнертабысы». Энн. Стат. 9 (3): 465–474. дои:10.1214 / aos / 1176345451.

- ^ Британника, «Ең кіші квадраттар әдісі»

- ^ Ықтималдықтар мен статистика тарихын зерттеу. ХХІХ: Ең кіші квадраттар әдісінің ашылуыR. Л.Плэкетт

- ^ Стиглер, Стивен М. (1986). Статистика тарихы: 1900 жылға дейінгі белгісіздікті өлшеу. Кембридж, MA: Гарвард университетінің Belknap баспасы. ISBN 978-0-674-40340-6.

- ^ Легендра, Адриен-Мари (1805), Nouvelles méthodes pour la détermination des orbites des comètes [Кометалар орбиталарын анықтаудың жаңа әдістері] (француз тілінде), Париж: Ф.Дидот

- ^ Олдрич, Дж. (1998). «Ең кіші квадраттар жасау: Гаусс пен Юлдың перспективалары». Халықаралық статистикалық шолу. 66 (1): 61–81. дои:10.1111 / j.1751-5823.1998.tb00406.x.

- ^ а б в г. Ықтималдық пен статистикаға заманауи кіріспе: неге және қалай екенін түсіну. Декинг, Мишель, 1946-. Лондон: Шпрингер. 2005 ж. ISBN 978-1-85233-896-1. OCLC 262680588.CS1 maint: басқалары (сілтеме)

- ^ Қате айнымалылармен жақсы таныстыру үшін мына сілтемені қараңыз Фуллер, В.А. (1987). Өлшеу қателіктерінің модельдері. Джон Вили және ұлдары. ISBN 978-0-471-86187-4.

- ^ а б в г. e f ж сағ Уильямс, Джеффри Х. (Джеффри Хув), 1956- (қараша 2016). Сандық өлшеу: сандардың озбырлығы. Morgan & Claypool Publishers ,, Физика институты (Ұлыбритания). Сан-Рафаэль [Калифорния] (40 Oak Drive, Сан-Рафаэль, Калифорния, 94903, АҚШ). ISBN 978-1-68174-433-9. OCLC 962422324.CS1 maint: бірнеше есімдер: авторлар тізімі (сілтеме) CS1 maint: орналасқан жері (сілтеме)

- ^ а б Ренчер, Элвин С .; Кристенсен, Уильям Ф. (2012-08-15). Көп айнымалы талдау әдістері. Джон Вили және ұлдары. б. 155. ISBN 978-1-118-39167-9.

- ^ Джир, Джеймс М. (2013). Материалдар механикасы. Гудно, Барри Дж. (8-ші басылым). Стэмфорд, Конн.: Cengage Learning. ISBN 978-1-111-57773-5. OCLC 741541348.

- ^ а б Тибширани, Р. (1996). «Регрессияның кішіреюі және лассо арқылы таңдау». Корольдік статистикалық қоғам журналы, B сериясы. 58 (1): 267–288. JSTOR 2346178.

- ^ Хасти, Тревор; Тибширани, Роберт; Фридман, Джером Х. (2009). Статистикалық оқыту элементтері (екінші басылым). Шпрингер-Верлаг. ISBN 978-0-387-84858-7. Архивтелген түпнұсқа 2009-11-10.

- ^ Бюлман, Петр; ван де Гир, Сара (2011). Жоғары өлшемді деректердің статистикасы: әдістері, теориясы және қолданылуы. Спрингер. ISBN 9783642201929.

- ^ Парк, Тревор; Каселла, Джордж (2008). «Байес Ласосы». Американдық статистикалық қауымдастық журналы. 103 (482): 681–686. дои:10.1198/016214508000000337. S2CID 11797924.

- ^ Бах, Фрэнсис Р (2008). «Bolasso: жүктеме арқылы ласоны бағалаудың моделі». Машиналық оқыту бойынша 25-ші халықаралық конференция материалдары: 33–40. arXiv:0804.1302. Бибкод:2008arXiv0804.1302B. дои:10.1145/1390156.1390161. ISBN 9781605582054. S2CID 609778.

- ^ Zare, Habil (2013). «Лассоның комбинаторлық анализіне негізделген ерекшеліктердің лимфомалық диагностикаға қосылуымен баллдық сәйкестігі». BMC Genomics. 14: S14. дои:10.1186 / 1471-2164-14-S1-S14. PMC 3549810. PMID 23369194.

Әрі қарай оқу

- Бьорк, Å. (1996). Ең кіші квадраттарға арналған есептердің сандық әдістері. СИАМ. ISBN 978-0-89871-360-2.

- Кария Т .; Курата, Х. (2004). Жалпыландырылған ең кіші квадраттар. Хобокен: Вили. ISBN 978-0-470-86697-9.

- Луенбергер, Д.Г. (1997) [1969]. «Ең кіші квадраттарды бағалау». Векторлық кеңістіктің әдістері бойынша оңтайландыру. Нью-Йорк: Джон Вили және ұлдары. 78-102 бет. ISBN 978-0-471-18117-0.

- Рао, C. Р.; Тутенбург, Х.; т.б. (2008). Сызықтық модельдер: ең кіші квадраттар және баламалар. Статистикадағы Springer сериясы (3-ші басылым). Берлин: Шпрингер. ISBN 978-3-540-74226-5.

- Wolberg, J. (2005). Ең кіші квадраттар әдісін қолдана отырып деректерді талдау: Тәжірибелерден ең көп ақпарат алу. Берлин: Шпрингер. ISBN 978-3-540-25674-8.

Сыртқы сілтемелер

Қатысты медиа Ең аз квадраттар Wikimedia Commons сайтында

Қатысты медиа Ең аз квадраттар Wikimedia Commons сайтында

![{ displaystyle operatorname {var} ({ hat { beta}} _ {j}) = sigma ^ {2} ([X ^ {T} X] ^ {- 1}) _ {jj} жуық { frac {S} {nm}} ([X ^ {T} X] ^ {- 1}) _ {jj},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f77b192f37c6a5f592a7e5b0601ec7fa95b6703d)